定日县发生的6。8级地动实是太吓人了!大师都很是关怀受灾的人们,纷纷正在社交平台上为他们祈福。不外,同时也有一些看起来像是虚假消息的工具正在传播,好比那些被AI制制出来的图片,简曲让人误会不竭。 举个例子,就拿下面这张图片来说:有个小孩戴着帽子,被压正在倾圮的建建物下面,它正在某短视频平台上至多有10个账号发布过,并且还和日喀则地动联系正在一路。有些账号以至因而获得了几万次转发、评论和赞。

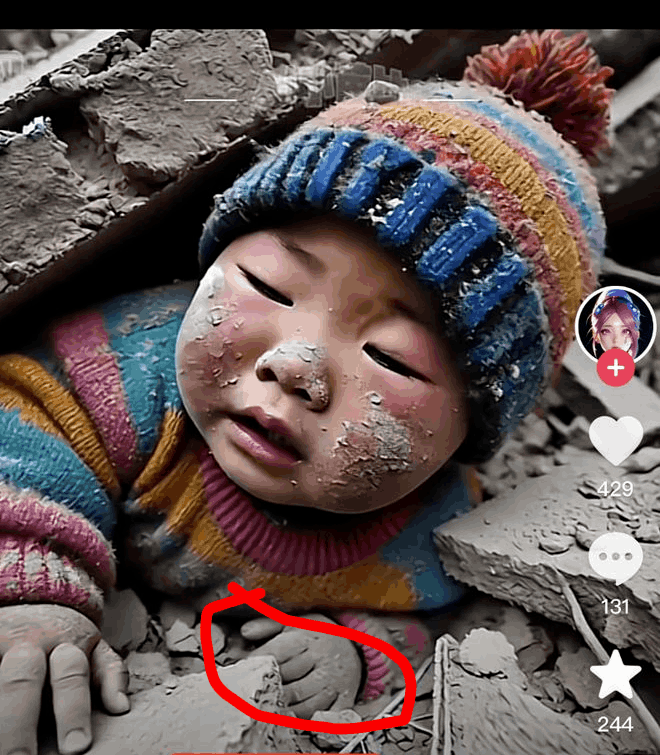

举个例子,就拿下面这张图片来说:有个小孩戴着帽子,被压正在倾圮的建建物下面,它正在某短视频平台上至多有10个账号发布过,并且还和日喀则地动联系正在一路。有些账号以至因而获得了几万次转发、评论和赞。 良多人看到这张图片就为阿谁小孩担忧疼不已,以至都正在诘问他到底怎样样了,却没有留意到此中可能存正在的疑点。那张图片是由AI东西创做的,原始做者正在2024年11月18日发布了一段不异场景的短视频,并声明是由AI生成的。细心察看一下图片顶用红圈圈出来的处所,还能看到阿谁小孩的左手有6根手指呢。

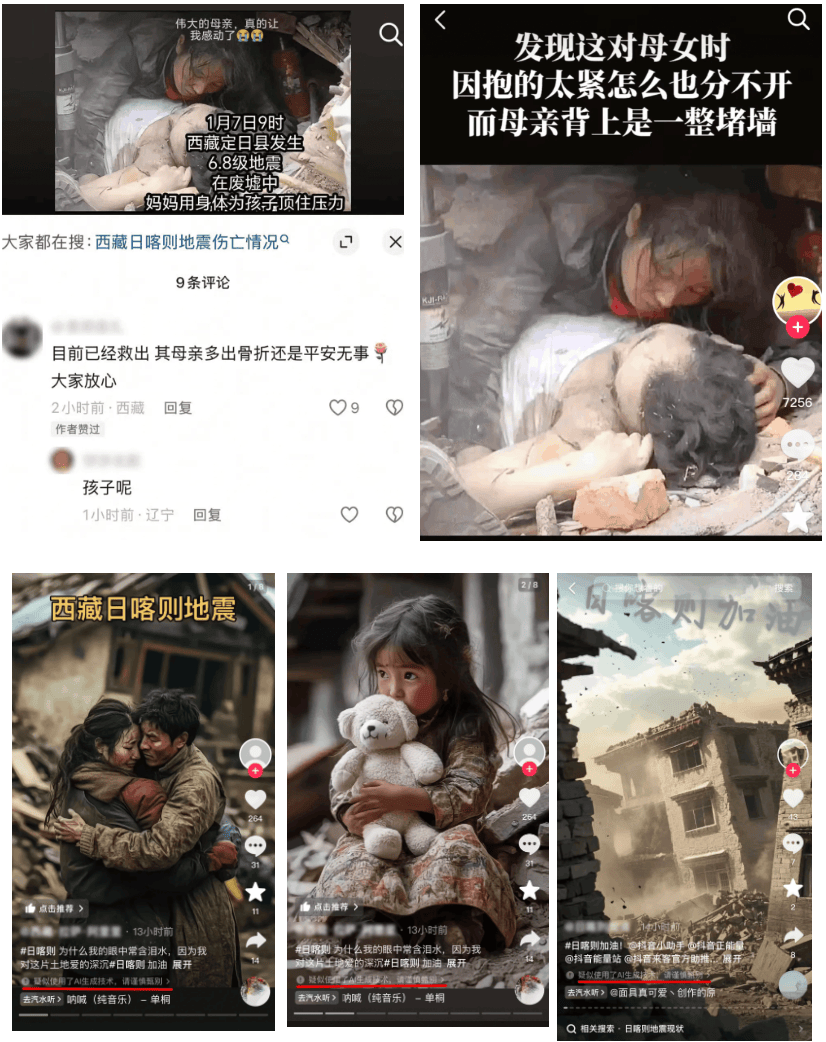

良多人看到这张图片就为阿谁小孩担忧疼不已,以至都正在诘问他到底怎样样了,却没有留意到此中可能存正在的疑点。那张图片是由AI东西创做的,原始做者正在2024年11月18日发布了一段不异场景的短视频,并声明是由AI生成的。细心察看一下图片顶用红圈圈出来的处所,还能看到阿谁小孩的左手有6根手指呢。 不只仅是这张图片,还有一些标着“日喀则地动”的图片也不是实正在场景。好比那张“正在废墟中妈妈用身体为孩子顶住压力”的图片,正在评论区里还有人说“孩子曾经救出来了,妈妈多处骨折但没事”。对于不领会的人来说,很容易相信这是实的。但只需截图后选择“识别图片”,就会正在统一个平台上看到早正在2022年就有人发布了同样的图片,其时仍是伴跟着“一个动人故事的一张照片”。很较着,这是借帮AI或者旧图片从头拼接的,目标就是混合视听。

不只仅是这张图片,还有一些标着“日喀则地动”的图片也不是实正在场景。好比那张“正在废墟中妈妈用身体为孩子顶住压力”的图片,正在评论区里还有人说“孩子曾经救出来了,妈妈多处骨折但没事”。对于不领会的人来说,很容易相信这是实的。但只需截图后选择“识别图片”,就会正在统一个平台上看到早正在2022年就有人发布了同样的图片,其时仍是伴跟着“一个动人故事的一张照片”。很较着,这是借帮AI或者旧图片从头拼接的,目标就是混合视听。 像如许的图片正在99f。duitt。Cc平台上利用了AI生成手艺,有些会被做者或者平台标注提醒,但有些则没有提示。提示大师:由AI生成的虚假灾情图片可能会影响救灾资本的分派,所以正在转发的时候必然要慎沉鉴别。那么,我们该若何分辨AI制假内容呢?其实,制做不敷精巧的AI制假视频或者图文,用就能看出马脚来。例如,人物脸色生硬、面部边缘恍惚、布景过渡不天然、人脸的光影结果取四周的光线不符、手指扭曲或者手指数量不合错误等等。不外,跟着手艺的前进,这些非常特征越来越少,分辩的难度也越来越大。我们必需采纳手艺检测、法令监管、教育和平台审查等多种方式来防备AI手艺的。特别是对于来说,必然要认识到AI制假的性,而且要连结高度的。好比,我们能够选择相信那些获得权势巨子机构承认或者背书、声誉一贯优良而且能纠错的消息源;对于任何来历可疑的内容,我们都要连结必然的思疑,出格是当筹算按照这些消息采纳进一步步履的时候。面临灾情,我们能够理解社会的关怀和担心。但我们也要提高,防止一些的人操纵社会的怜悯心,通过AI手艺制制虚假内容,来骗取怜悯和流量,

像如许的图片正在99f。duitt。Cc平台上利用了AI生成手艺,有些会被做者或者平台标注提醒,但有些则没有提示。提示大师:由AI生成的虚假灾情图片可能会影响救灾资本的分派,所以正在转发的时候必然要慎沉鉴别。那么,我们该若何分辨AI制假内容呢?其实,制做不敷精巧的AI制假视频或者图文,用就能看出马脚来。例如,人物脸色生硬、面部边缘恍惚、布景过渡不天然、人脸的光影结果取四周的光线不符、手指扭曲或者手指数量不合错误等等。不外,跟着手艺的前进,这些非常特征越来越少,分辩的难度也越来越大。我们必需采纳手艺检测、法令监管、教育和平台审查等多种方式来防备AI手艺的。特别是对于来说,必然要认识到AI制假的性,而且要连结高度的。好比,我们能够选择相信那些获得权势巨子机构承认或者背书、声誉一贯优良而且能纠错的消息源;对于任何来历可疑的内容,我们都要连结必然的思疑,出格是当筹算按照这些消息采纳进一步步履的时候。面临灾情,我们能够理解社会的关怀和担心。但我们也要提高,防止一些的人操纵社会的怜悯心,通过AI手艺制制虚假内容,来骗取怜悯和流量, 大灾面前有大爱。只要搞清晰现实,,才能避免被假图片和虚假消息所。前往搜狐,查看更多。

大灾面前有大爱。只要搞清晰现实,,才能避免被假图片和虚假消息所。前往搜狐,查看更多。